搜索到

13

篇与

的结果

-

深度调研:主流虚拟机与容器 GPU 直通(Passthrough)方案全解析 在高性能计算、深度学习及远程桌面(VDI)领域,如何让虚拟机(VM)或容器高效地调用宿主机显卡资源是核心课题。本文总结了目前主流的显卡直通技术路径,涵盖 Docker、Type 1/2 虚拟机及风扇控制等配套方案。一、 容器化方案:Docker GPU 调用对于不需要完整操作系统开销的场景,Docker 是最简便的选择。核心工具:nvidia-container-toolkit。实现方式:无需特殊启动命令,只需在标准 Docker 命令中加入 --gpus 标志。示例:docker run --gpus all nvidia/cuda:12.0-base nvidia-smi限制:目前该方案主要适用于 NVIDIA 显卡。二、 虚拟机监控器(Hypervisor)方案对比根据底层架构的不同,显卡直通的难度和稳定性存在差异。1. Type 1 Hypervisor(原生型)直接运行在硬件上,性能损耗极低,是生产环境的首选。平台特点直通方案Proxmox VE (PVE)开源、功能强大通过修改 vfio 配置实现。支持 TCC 模式切换(可将普通卡伪装成 Quadro 专业卡)。VMware ESXi企业级稳定8.0 免费版即可实现 GPU 直通,且 Linux 虚拟机下无需额外授权。Windows ServerWindows 环境友好使用 DDA (Discrete Device Assignment) 实现稳定直通,优于不稳定的 GPU-PV。2. Type 2 Hypervisor(托管型)运行在操作系统之上,通常用于个人开发环境。VMware Workstation:支持添加 PCI 设备进行显卡直连,但在性能和稳定性上略逊于 Type 1。Oracle VirtualBox:教程较少,直通复杂度高。三、 重点实战路径与教程索引🔹 Proxmox VE (PVE)PVE 在显卡直通上的灵活性最高。通过在直通设备上修改显卡 ID 为 Quadro 系列的 DeviceID,可以强行开启 TCC (Tesla Compute Cluster) 模式,这对提升计算效率非常有帮助。实战参考:PVE 8.4 针对 2080 Ti 及 3090 的直通指南已非常成熟。🔹 VMware ESXi 8.0ESXi 的图形化界面操作相对友好。避坑指南:在 ESXi 8.0 中直通 NVIDIA 显卡至 Linux 系统时,需注意驱动版本的匹配,部分场景下需要调整高级设置参数以绕过驱动限制。🔹 Windows Server (Hyper-V)在 Windows 环境下,DDA 是唯一推荐的生产级直通方式。相比之下,GPU-PV(半虚拟化)虽然设置简单,但在高负载下容易出现不稳定的情况。四、 特殊硬件与配套调优1. Intel DG1/DG2 显卡目前 Intel 独显在 PVE 和 ESXi 上的直通已有成功案例,甚至可以配合群晖 SA6400 驱动进行视频转码加速。2. 散热与风扇控制显卡满载运行会产生巨大热量。在 PVE 或 Ubuntu 宿主机上,可以通过 fancontrol 和 pwmconfig 工具实现根据 GPU 温度动态调整主板风扇转速,确保硬件寿命。五、 调研结论与部署策略经过对比测试,针对不同应用场景,我们制定了以下最佳部署实践:目标系统推荐宿主机平台直通技术备注Windows 虚拟机Windows ServerDDA稳定性最高,兼容性最好。Linux 虚拟机ESXi 8.0PCI Passthrough部署便捷,无需授权即可满足生产需求。计算性能测试Proxmox VE (PVE)TCC Mode未来计划使用 PVE 开启 TCC 模式,若训练提升明显,将作为 Linux 的首选平台。💡 技术核心点总结:WDDM vs TCC:WDDM 模式兼顾显示和计算,但有系统开销;TCC 模式完全为计算而生,能够显著优化 CUDA 内存管理和任务调度。vGPU 注意事项:对于整租 GPU 场景,vGPU-Unlock 等补丁项目通常无实际增益,应优先考虑物理直通。下一步建议:如果你需要开始部署,我可以为你整理 PVE 开启 TCC 模式的具体指令集,或者 ESXi 8.0 直通时的常用参数配置表。你想先深入哪一部分?

-

如何避免DNS劫持? 常见的科学上网姿势是购买一个机场,机场会给你一个订阅链接,将这个链接填入客户端(例如Clash)后,客户端会通过订阅链接下载一个配置文件到本地。在新手阶段,大家更关注的是节点(Proxies)和规则(Rules),这两者共同决定了不同目标网站的流量路径。直到遭遇DNS劫持。常见的节点类型包括ss、vmess、http,它们都支持流量加密和伪装,但节点地址都是以域名的形式表达的,那么就涉及到域名解析(DNS)。为了表述方便,将全过程简化如下:客户端A----DNS1----|墙GFW|----节点M----DNS2----目标服务器X一般来说,M是“看上去”身份合法的,GFW会允许A正常解析M的IP地址并连接到M。而一旦到了M,剩下的问题就不大了,M负责联系X,并将加密、混淆后的数据传给A。但某些情况下,GFW会“破获”某些机场使用的节点M们,或者某段时间检测到某个M流量突增,一看传输内容都是混淆后的不知所云的数据,再一检测又发现它并不是一个正常的网站,就有可能将它列入“嫌疑人名单”。那么为了阻止A连接M,通常采取的措施之一就是DNS劫持。在“客户端A----DNS1----|墙GFW|----节点M----DNS2----目标服务器X”链条中,前两个是在GFW的“势力范围”。很明显,DNS劫持将在“DNS1”这一步来实现。例如,某个节点的域名是xeqdfik3.abc.top,它正确的解析地址应该是:67.229.123.123(位于洛杉矶)。当GFW怀疑它时,就会强行在“DNS1”这一步,将xeqdfik3.abc.top的解析地址劫持为:221.228.32.13(位于国内某省某ISP数据中心),那么A就连不上真正的M,整个数据链当然就被破坏了。不仅如此,该数据中心还会不断收到你的请求“给我转接网站X!我的认证密钥是!”这就太尴尬了。所以,我们需要仔细研究一下配置文件中的DNS相关设置,对它进行一番必要的改造。这个配置文件,就是通过订阅链接下载下来的文件,对于Clash来说通常后缀名是YML。dns段dns段以“dns:”开头,通常位于配置文件的靠前位置。需要重点关注其中的“default-nameserver”与“nameserver”配置项。其中nameserver是Clash日常使用的主要设置。如果仔细看过多家机场的配置文件,就会发现一个惊人的事实:default-nameserver与nameserver中,大量充斥着这样一些IP:223.5.5.5(阿里)、223.6.6.6(阿里)、119.28.28.28(腾讯)、119.29.29.29(腾讯)、120.53.53.53(腾讯)、180.184.1.1(字节跳动)……出于“保护”你的需要,它们都会将一些“怀疑对象域名”的DNS解析劫持到错误的地址,让你无法访问,或干脆跳到反诈网站首页,甚至可以让你直接跳转到新浪。你的亲密战友“M”很可能不幸被列入其中。那么,是否将nameserver换成可靠的DNS,例如:8.8.8.8(Google)、1.1.1.1(Cloudflare),就一定能找到M了呢?未必。使用可靠的DNS当然会返回正确的解析地址,但这个正确的结果能不能递到你手上就难说了。因为默认情况下,整个DNS查询过程对于ISP来说仍然是透明的,GFW/ISP知道你是谁,也知道你在什么时候向8.8.8.8提出了一个域名M的解析请求,这仍然会暴露整个“不法行径”。同时,由于整个交易地点是GFW/ISP的主场,它可以强行改变结果,仿佛戴上了一枚“现实戒指”。打个容易理解的比方:你在街头想买点毒品,根据配置文件,你找的卖方(DNS)是223.5.5.5,它和你完成了交易,但卖给你的是假货,你回家发现这粉一点儿劲都没有————这就是你使用默认配置文件时发生的事情。第二次你聪明了,你修改了配置文件,找到了正确的卖方(DNS)8.8.8.8,它和你完成了交易,它拿出来的也是真货,但全程有一个警察站在旁边,他“啪”地一下打掉了8.8.8.8给你的真货(解析结果数据包),然后反手塞给你一包普通面粉。————这就是透明代理下发生的事情。所以,我们需要用到DoH(DNS over Https)。将nameserver的表达形式从IP改成一个https链接,如下所示:nameserver:- https://dns.google/dns-query # Google - https://1.1.1.1/dns-query # Cloudflare这就把默认情况下通过53端口与DNS的明文通信,变成了通过443端口与DNS的Https加密通信。虽然整个交易仍然在GFW/ISP的主场进行,但现场多了一只牢不可破的保险箱,你把解析请求放入保险箱,而DNS从保险箱里读取请求,并把解析结果也放进保险箱,你最后从保险箱中拿到结果————整个过程是加密的。从理论上讲,你们交易的可能是“毒品”,也有可能是完全无害的两只苹果,这就让GFW/ISP的干预失去了“法理基础”。好了,经过千辛万苦,客户端A终于知道了M的真实地址,下面可以愉快地通信了。别急,在clash的安卓端,在dns:段还有一个单独的设置:clash-for-android:clash-for-android: append-system-dns: false顾名思义,它的意思是,在DNS解析的时候是不是要加上系统(指的是安卓系统)自身的DNS啊?如果是国内品牌的安卓手机,那当然是信不过的;那如果是类似三星这样的国外品牌手机呢?其实也一样,因为在默认情况下,安卓系统会从ISP那里获取DNS,通常是你所在当地的、延迟低的DNS,以保障网络的通畅。所以,只要你用的是国内的ISP,那都是不值得托付的啊!所以这一项必须是false。fakeip与geoip根据以上设置完,所有的DNS解析都非常可靠了,但牺牲了速度:用Google和Cloudflare的DNS解析国内的网站很慢,有时候甚至需要好几秒,这很不爽。因此可以借用Clash自带的fake-ip和geoip,将国内与国外的DNS解析分开,同时提供DNS缓存功能。在dns段增加fake-ip和geoip的设定,同时将nameserver重新设置成国内的DNS:dns: enhanced-mode: fake-ip fake-ip-range: 198.18.0.1/16 fake-ip-filter:- '*.lan' - '*.localdomain' - '*.example' - '*.invalid' - '*.localhost' - '*.test' - '*.local' - '*.home.arpa'nameserver:- 119.28.28.28 - 119.29.29.29 - 223.5.5.5 - 223.6.6.6fallback:- https://dns.google/dns-query - https://1.1.1.1/dns-query - 8.8.8.1 - 1.1.1.1fallback-filter:geoip: true注意,虽然nameserver又设置成了万恶的国内DNS,但fallback-filter设置为geoip为true,这一项确保了只有国内服务器地址才会被nameserve解析。国外服务器地址将使用fallback中的DNS——这就兼顾了安全与效率。开启fake-ip后,DNS服务器甚至不知道请求客户端的IP,这就进一步防止了泄漏。fake-ip还有一个好处是,由于它在DNS请求中加了一层(真实客户端IP-伪造的客户端IP),它还“赠送”了一个DNS缓存服务,这就使得你的DNS请求大部分时候直接从缓存中读取,无需请求DNS服务器,进一步提高了效率。需要注意的是,该模式下可能无法使用一些银行客户端APP,因为这些APP会检测客户端IP是否合法。一个局域网地址192.18.0.10显然不能过关。不过相信你应该知道如何设置Clash客户端的APP例外吧。hosts段对于机场提供的M们来说,你不需要了解它们指向的具体IP,因为很可能为了应对诡谲多变的网络环境,这些IP是会变化的,通过前文的措施进行可靠的DNS解析就可以了。那么还有一种节点,它是自建的,一般情况下,它的IP是固定的————这时候就可以采用更简单粗暴的方法:直接指定hosts。在配置文件中,hosts:段与dns:段平行,都属于最上一级。格式如下:hosts: "m01.abc.top": 152.22.10.10 "m02.abc.top": 69.13.125.105这样一来,啥DNS都不需要了,Clash将直接把域名替换成IP地址。解决了DNS劫持并不是万能的需要补充说明的是,前文都是围绕着如何把M的域名转换为真实的IP地址以建立连接,但对域名的DNS污染或劫持,只是GFW可能采用的部分手段,并非全部手段。GFW有能力直接屏蔽IP,这件事如果发生,那么M除了更换IP之外别无它法。幸好,GFW并不会滥用这个终极杀招,因为IP资源是有限的,某个IP也未必永远提供着“不良内容”,它有可能会被转手,也可能因为网络调整而变化。为了防止这件事发生,客户端A在和M接上头之后,如何进行隐蔽的通讯,减少M“毒贩”身份的暴露,也是有讲究的。tls加密常用的节点类型中,ss默认使用的是密码加密,也可以通过插件,再加上一层https,实现tls加密。而vmess和http原生就支持tls加密。但必须注意的是,我们需要在配置文件中指定这一点,才能强制它验证https证书和使用tls加密,以进一步确保数据的安全:tls: true skip-cert-verify: false当然,在这种设置下,要确保M的https证书保持更新。可以使用自动续期脚本来实现这一点。这样一来,客户端A与M之间传递的数据,将全部加密,某种程度上保护了M的安全,延长了M的“生命周期”。客户端设置配置文件经过上述的调整,已经可以满足安全要求。但在安卓版的clash客户端上,还有一些需要调整的地方。首先在“设置”-“覆写”-“DNS”-“策略”中,默认是“使用内置”,建议改为“强制启用”。这将强行使用配置文件中的设置,而不使用安卓系统内置的DNS服务。经过测试发现,移动运营商(联通、移动、电信在手机端)可能会不支持DoH,导致nameserver中的设置失效,其结果就是导致所有的M们都失联。这时候,Fallback Name Server的设置就派上了用场。在“设置”-“覆写”-“DNS”-“Fallback Name Server”中,添加8.8.8.8和1.1.1.1。当DoH不管用的时候,就会切换到这两个备用DNS。“覆写”功能是比较方便的,它让你不用每次都手动修改订阅链接下载下来的配置文件,而是用一套覆写规则自动覆盖相关条目。在“DNS”设置下,还可以参考前文,手动设置nameserver、添加Name Server策略等,此处不再赘述。原文来自lucyqin_blog: https://blog.lucyqin.cn/?p=1874

-

解决未来的AI的能源问题?可控核聚变?太空GPU集群?(与gpt5.4对话) 对话整理:从“当前距离发明可控核聚变最大的难题是什么?”开始1. 可控核聚变当前最大的难题结论当前距离“真正可用的可控核聚变”最大的难题,不只是点燃一次聚变反应,而是:让高温等离子体长期、稳定、可控地维持实现持续净能量增益解决材料耐受问题解决氚增殖与工程化发电问题核心观点真正难的不是“做出一次聚变”,而是把它变成稳定、连续、可发电、可工程化的系统。本质上最核心的一关还是:高温等离子体的长期稳定约束。2. 用户提出观点:未来 AI 算力集群放到太空空间站更现实用户观点用户认为:AI 未来最缺的是稳定而强大的电力太空空间站可以依赖太阳能所以把 AI 算力中心放到太空,可能比地面更现实回应后的核心判断结论是否定的:短期到中期,太空空间站并不是更现实的 AI 主战场更像是特殊用途的补充路线主力训练集群在未来较长时间内仍然会在地面主要原因AI 集群真正缺的是大规模稳定供电 + 配套工程能力太空并不天然更好散热,反而更难发射、维护、换代成本极高不适合频繁扩容、维修和硬件迭代更适合做在轨边缘计算,而不是主力训练中心3. 关于太空站散热问题用户追问用户提出:太空太阳能似乎能解决电力问题那显卡散热有没有成熟方案?整理后的回答有,但要分清楚两件事:已经成熟的成熟的是:航天器电子设备热控方案其典型路线是:芯片/设备发热通过冷板、热管、液冷回路带走热量再送到外部散热器最后通过热辐射把热量排到太空还不成熟的不成熟的是:太空站超大规模 AI 显卡集群散热方案核心差别“少量高功耗电子设备在太空散热”已经是成熟工程问题“成千上万张 GPU 在太空长期训练”不是成熟方案本质难点太空里没有常规空气对流,最后只能主要靠辐射散热。 所以问题不在于“能不能给一张显卡液冷”,而在于:总热量怎么排出去散热器要做多大系统质量会不会暴涨结构和姿态控制会不会越来越复杂4. 用户提出:通信问题可以由 Starlink 解决用户观点用户认为:既然通信是问题那么 Musk 的 Starlink 也许能解决整理后的回答结论是:Starlink 能缓解通信问题但解决不了太空 AI 主力训练集群的根本问题原因Starlink 更适合解决的是:链路可达覆盖范围一般意义上的数据回传但不等于能解决:太空训练集群内部的超高速互联超大规模参数同步训练过程中的系统级网络要求核心判断Starlink 适合“在轨数据回传”和“边缘计算通信”不适合把太空节点直接变成地面 hyperscale 训练集群的等价替代品5. 用户进一步强调:训练过程完全可以在太空 GPU 集群上完成用户观点用户从算法工程师角度出发,认为:模型训练完全可以整体放在太空 GPU 集群完成这样就不需要反复依赖地面通信所以没必要过分担心通信问题整理后的回应这个前提只成立一半:如果训练全过程都放在太空,确实可以显著降低“地面—太空实时通信”的重要性但即便通信不是主问题,真正压人的仍然是其他更硬的工程问题真正更大的问题即使不考虑通信,仍然有四大核心障碍:1. 散热太空散热最终主要靠辐射功率越大,散热器面积和系统复杂度越高2. 供电系统整体质量不是“装太阳能板”这么简单发多少电,最终就要排多少热电力系统和热控系统是绑死的3. 空间辐射与可靠性高性能芯片在太空会受到辐射影响会出现软错误、位翻转、异常中断,甚至器件损伤对大模型训练来说,这类 silent error 很致命4. 维护与换代地面训练集群靠频繁更换 GPU、交换机、电源、冷却部件维持效率太空环境下维护和升级成本极高不适合像地面那样高速迭代最终结论通信不是太空训练集群最核心的障碍更核心的是:散热电力系统质量辐射可靠性维护换代成本6. 整段讨论的总判断最终整理结论从整段讨论看,形成的主线结论是:关于核聚变可控核聚变最大的难题,是把聚变从“实验成功”推进到“长期稳定、持续净增益、可工程发电”。关于太空 AI 集群太空算力并非完全没前景,但更现实的方向是:在轨边缘计算在轨推理在轨预处理在轨数据筛选与压缩而不是:把未来主力超大模型训练中心整体搬上太空一句话总结把 AI 算力搬到太空,最不该高估的是通信改善,最不该低估的是散热、供电、辐射和维护成本。7. 可作为文末备注的事实校正以下几条是这段讨论里涉及的、可由公开资料支持的事实:ITER 的目标之一就是实现并研究可由聚变自身加热维持的燃烧等离子体,这说明“长期稳定约束高温等离子体”仍是聚变工程中的核心难题。 oai_citation:0‡NASA空间热控的成熟路线确实是“热获取—热传输—热排出”,ISS 热控系统就是通过回路把热量送到外部散热器,再向太空辐射。 oai_citation:1‡NASAAxiom Space 目前推进的是轨道数据中心与在轨数据处理能力,定位更接近空间数据处理、AI/ML 与安全场景,而不是已经成熟可替代地面超大规模训练中心的方案。 oai_citation:2‡Axiom SpaceGoogle Research 公开讨论过空间可扩展 AI 基础设施设想,但其出发点是探索未来可能性,不代表“太空大规模 AI 训练集群已经工程成熟”。 oai_citation:3‡Google Research

解决未来的AI的能源问题?可控核聚变?太空GPU集群?(与gpt5.4对话) 对话整理:从“当前距离发明可控核聚变最大的难题是什么?”开始1. 可控核聚变当前最大的难题结论当前距离“真正可用的可控核聚变”最大的难题,不只是点燃一次聚变反应,而是:让高温等离子体长期、稳定、可控地维持实现持续净能量增益解决材料耐受问题解决氚增殖与工程化发电问题核心观点真正难的不是“做出一次聚变”,而是把它变成稳定、连续、可发电、可工程化的系统。本质上最核心的一关还是:高温等离子体的长期稳定约束。2. 用户提出观点:未来 AI 算力集群放到太空空间站更现实用户观点用户认为:AI 未来最缺的是稳定而强大的电力太空空间站可以依赖太阳能所以把 AI 算力中心放到太空,可能比地面更现实回应后的核心判断结论是否定的:短期到中期,太空空间站并不是更现实的 AI 主战场更像是特殊用途的补充路线主力训练集群在未来较长时间内仍然会在地面主要原因AI 集群真正缺的是大规模稳定供电 + 配套工程能力太空并不天然更好散热,反而更难发射、维护、换代成本极高不适合频繁扩容、维修和硬件迭代更适合做在轨边缘计算,而不是主力训练中心3. 关于太空站散热问题用户追问用户提出:太空太阳能似乎能解决电力问题那显卡散热有没有成熟方案?整理后的回答有,但要分清楚两件事:已经成熟的成熟的是:航天器电子设备热控方案其典型路线是:芯片/设备发热通过冷板、热管、液冷回路带走热量再送到外部散热器最后通过热辐射把热量排到太空还不成熟的不成熟的是:太空站超大规模 AI 显卡集群散热方案核心差别“少量高功耗电子设备在太空散热”已经是成熟工程问题“成千上万张 GPU 在太空长期训练”不是成熟方案本质难点太空里没有常规空气对流,最后只能主要靠辐射散热。 所以问题不在于“能不能给一张显卡液冷”,而在于:总热量怎么排出去散热器要做多大系统质量会不会暴涨结构和姿态控制会不会越来越复杂4. 用户提出:通信问题可以由 Starlink 解决用户观点用户认为:既然通信是问题那么 Musk 的 Starlink 也许能解决整理后的回答结论是:Starlink 能缓解通信问题但解决不了太空 AI 主力训练集群的根本问题原因Starlink 更适合解决的是:链路可达覆盖范围一般意义上的数据回传但不等于能解决:太空训练集群内部的超高速互联超大规模参数同步训练过程中的系统级网络要求核心判断Starlink 适合“在轨数据回传”和“边缘计算通信”不适合把太空节点直接变成地面 hyperscale 训练集群的等价替代品5. 用户进一步强调:训练过程完全可以在太空 GPU 集群上完成用户观点用户从算法工程师角度出发,认为:模型训练完全可以整体放在太空 GPU 集群完成这样就不需要反复依赖地面通信所以没必要过分担心通信问题整理后的回应这个前提只成立一半:如果训练全过程都放在太空,确实可以显著降低“地面—太空实时通信”的重要性但即便通信不是主问题,真正压人的仍然是其他更硬的工程问题真正更大的问题即使不考虑通信,仍然有四大核心障碍:1. 散热太空散热最终主要靠辐射功率越大,散热器面积和系统复杂度越高2. 供电系统整体质量不是“装太阳能板”这么简单发多少电,最终就要排多少热电力系统和热控系统是绑死的3. 空间辐射与可靠性高性能芯片在太空会受到辐射影响会出现软错误、位翻转、异常中断,甚至器件损伤对大模型训练来说,这类 silent error 很致命4. 维护与换代地面训练集群靠频繁更换 GPU、交换机、电源、冷却部件维持效率太空环境下维护和升级成本极高不适合像地面那样高速迭代最终结论通信不是太空训练集群最核心的障碍更核心的是:散热电力系统质量辐射可靠性维护换代成本6. 整段讨论的总判断最终整理结论从整段讨论看,形成的主线结论是:关于核聚变可控核聚变最大的难题,是把聚变从“实验成功”推进到“长期稳定、持续净增益、可工程发电”。关于太空 AI 集群太空算力并非完全没前景,但更现实的方向是:在轨边缘计算在轨推理在轨预处理在轨数据筛选与压缩而不是:把未来主力超大模型训练中心整体搬上太空一句话总结把 AI 算力搬到太空,最不该高估的是通信改善,最不该低估的是散热、供电、辐射和维护成本。7. 可作为文末备注的事实校正以下几条是这段讨论里涉及的、可由公开资料支持的事实:ITER 的目标之一就是实现并研究可由聚变自身加热维持的燃烧等离子体,这说明“长期稳定约束高温等离子体”仍是聚变工程中的核心难题。 oai_citation:0‡NASA空间热控的成熟路线确实是“热获取—热传输—热排出”,ISS 热控系统就是通过回路把热量送到外部散热器,再向太空辐射。 oai_citation:1‡NASAAxiom Space 目前推进的是轨道数据中心与在轨数据处理能力,定位更接近空间数据处理、AI/ML 与安全场景,而不是已经成熟可替代地面超大规模训练中心的方案。 oai_citation:2‡Axiom SpaceGoogle Research 公开讨论过空间可扩展 AI 基础设施设想,但其出发点是探索未来可能性,不代表“太空大规模 AI 训练集群已经工程成熟”。 oai_citation:3‡Google Research -

开始正式备考11408了 以下是相关的计划,这学期学校的课程貌似很满,但是大多数都没啥用,课程的质量很低,所以课是能逃课就逃课,不能逃课就在课上学习,估计按照我的水平及时大多数时间都不听讲也可以满足课程最低的要求📅 考研 90 天计划(第一轮·进度打钩表)周次数学 (张宇30讲·新课)408 专业课 (一轮)英语 (红宝书 约35词/天 + 真题精读)政治进度打钩Week 1第 1 - 3 讲DS:线性表必考词 Unit 1-3 + 2010真题 Read 1-2少量了解[ ]Week 2第 4 - 6 讲DS:栈、队列、数组必考词 Unit 4-6 + 2010真题 Read 3-4少量了解[ ]Week 3第 7 - 9 讲DS:树与二叉树必考词 Unit 7-9 + 2011真题 Read 1-2少量了解[ ]Week 4第 10 - 12 讲DS:图、查找、排序必考词 Unit 10-12 + 2011真题 Read 3-4少量了解[ ]Week 5第 13 - 15 讲CO:系统概述、运算必考词 Unit 13-15 + 2012真题 Read 1-2少量了解[ ]Week 6第 16 - 17 讲CO:存储器、指令必考词 Unit 16-18 + 2012真题 Read 3-4少量了解[ ]Week 7第 18 - 19 讲CO:CPU、总线、I/O必考词 Unit 19-21 + 2013真题 Read 1-2少量了解[ ]Week 8第 20 - 22 讲OS:进程管理、同步必考词 Unit 22-24 + 2013真题 Read 3-4少量了解[ ]Week 9第 23 - 24 讲OS:内存、文件、IO必考词 U25-26 + 基础词 U1 + 2014真题 R1-2少量了解[ ]Week 10第 25 - 26 讲CN:物理层、链路层基础词 Unit 2-4 + 2014真题 Read 3-4少量了解[ ]Week 11第 27 - 28 讲CN:网络层基础词 Unit 5-7 + 2015真题 Read 1-2少量了解[ ]Week 12第 29 - 30 讲CN:传输层、应用层基础词 Unit 8-10 + 2015真题 Read 3-4少量了解[ ]🕒 每日时间模板(每日更新项)时间段科目任务描述状态08:30 - 09:30英语背单词[ ]09:30 - 10:30英语真题阅读 / 长难句[ ]10:40 - 12:00数学新课 / 公式 / 例题[ ]13:00 - 15:30408一轮主任务[ ]15:40 - 17:30408例题 / 章节题 / 总结[ ]17:30-18:30回家+跑步40分钟 [ ]19:00 - 21:30数学做题训练 / 错题整理[ ]21:30- 22:00政治 / 英语政治 or 补今日落下内容[ ]22:00休息+放松冥想洗澡生活[ ]执行了两天了,感觉状态还不错。大家可以在这里监督我并且给我提出一些建议。

开始正式备考11408了 以下是相关的计划,这学期学校的课程貌似很满,但是大多数都没啥用,课程的质量很低,所以课是能逃课就逃课,不能逃课就在课上学习,估计按照我的水平及时大多数时间都不听讲也可以满足课程最低的要求📅 考研 90 天计划(第一轮·进度打钩表)周次数学 (张宇30讲·新课)408 专业课 (一轮)英语 (红宝书 约35词/天 + 真题精读)政治进度打钩Week 1第 1 - 3 讲DS:线性表必考词 Unit 1-3 + 2010真题 Read 1-2少量了解[ ]Week 2第 4 - 6 讲DS:栈、队列、数组必考词 Unit 4-6 + 2010真题 Read 3-4少量了解[ ]Week 3第 7 - 9 讲DS:树与二叉树必考词 Unit 7-9 + 2011真题 Read 1-2少量了解[ ]Week 4第 10 - 12 讲DS:图、查找、排序必考词 Unit 10-12 + 2011真题 Read 3-4少量了解[ ]Week 5第 13 - 15 讲CO:系统概述、运算必考词 Unit 13-15 + 2012真题 Read 1-2少量了解[ ]Week 6第 16 - 17 讲CO:存储器、指令必考词 Unit 16-18 + 2012真题 Read 3-4少量了解[ ]Week 7第 18 - 19 讲CO:CPU、总线、I/O必考词 Unit 19-21 + 2013真题 Read 1-2少量了解[ ]Week 8第 20 - 22 讲OS:进程管理、同步必考词 Unit 22-24 + 2013真题 Read 3-4少量了解[ ]Week 9第 23 - 24 讲OS:内存、文件、IO必考词 U25-26 + 基础词 U1 + 2014真题 R1-2少量了解[ ]Week 10第 25 - 26 讲CN:物理层、链路层基础词 Unit 2-4 + 2014真题 Read 3-4少量了解[ ]Week 11第 27 - 28 讲CN:网络层基础词 Unit 5-7 + 2015真题 Read 1-2少量了解[ ]Week 12第 29 - 30 讲CN:传输层、应用层基础词 Unit 8-10 + 2015真题 Read 3-4少量了解[ ]🕒 每日时间模板(每日更新项)时间段科目任务描述状态08:30 - 09:30英语背单词[ ]09:30 - 10:30英语真题阅读 / 长难句[ ]10:40 - 12:00数学新课 / 公式 / 例题[ ]13:00 - 15:30408一轮主任务[ ]15:40 - 17:30408例题 / 章节题 / 总结[ ]17:30-18:30回家+跑步40分钟 [ ]19:00 - 21:30数学做题训练 / 错题整理[ ]21:30- 22:00政治 / 英语政治 or 补今日落下内容[ ]22:00休息+放松冥想洗澡生活[ ]执行了两天了,感觉状态还不错。大家可以在这里监督我并且给我提出一些建议。 -

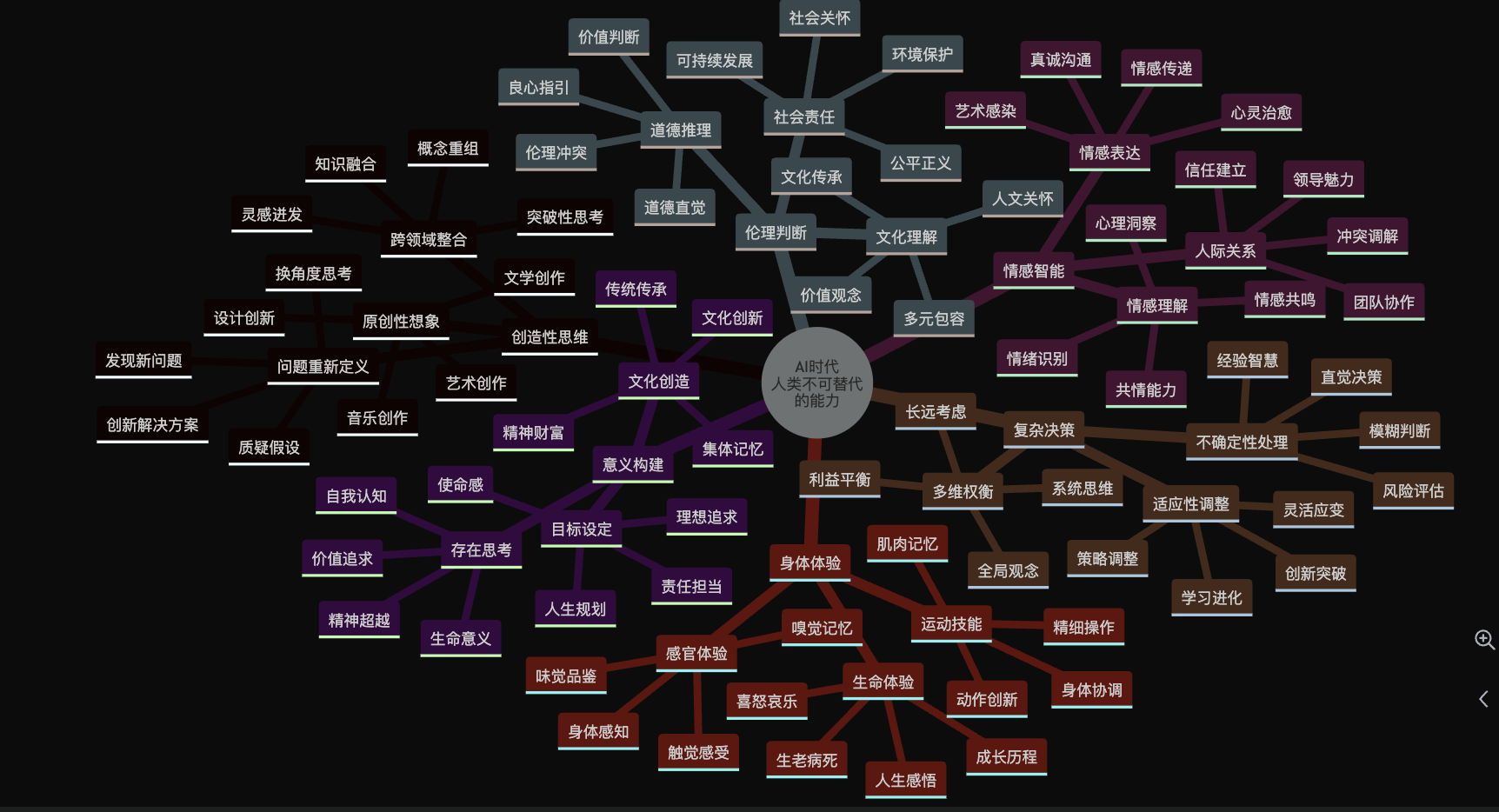

ai时代“热爱”尤其珍贵 随着ai时代爆炸的发展,在感叹于ai的能力强大的同时也在后怕,如此的一个强大且不知疲倦的东西是否真的可以替代我们? 现有的工作岗位是否都会被取代? 昨天晚上10点在和朋友交流的过程中,她问我什么岗位以后不会失业呢?确实把我问懵了,随之而来的是无穷的痛苦。结合最近和各种不同层次的人进行讨论的结果,我觉得需要进行总结下,大致分为的以下几种,顺便从一个程序员的角度聊一聊。一、认为容易且缺乏创造性的工作会失业认为低端且重复的工作会被取代,这个概念其实很不严谨。因为每个人对于“低端”、“重复”的定义不同,到底什么是重复性强? 什么是容易?显然我们需要一个清晰的逻辑,才能继续讨论。可能大多数人都认为有一些工作是重复性强的,是容易的。但是要合理的评价事情的容易以及重复性需要建立一个统一的评价指标。毕竟就像是一个简单的mlp(多层感知)的代码实现,对于一个资深的算法工程师来说很简单,但是对于一个大学生来说并不容易。该如何建立这个评价体系是个非常大的问题,如果纯从技术和学术的角度出发,任何已有的知识都是一个简单且容易的事情。例如,修建一条跨海隧道,有很多成功的案例,不困难。真的困难的是人类尚未解决的问题,例如大到,可控核聚变、常温超导体,小到大参数llm模型的幻觉问题。本质是“概率预测”而非“数据库”: LLM 的底层逻辑是下一个词预测 (Next-token prediction)。它们并没有像传统数据库那样存储具体的“事实”,而是通过海量数据学习到了词汇之间的统计和概率关系。当它生成一段看似合理的文本时,它是在进行概率拼接,而不是在“回忆”客观真理。缺乏对真实世界的真正理解: 模型没有常识,也没有物理世界的运行逻辑。只要生成的文本在语法和概率上是顺畅的,模型就会自信地输出,即使内容违背了客观事实。训练数据的局限性: 训练大模型的数据往往包含了互联网上的错误信息、偏见、甚至自相矛盾的内容。模型吸收了这些“有毒”数据,自然也会在输出中反映出来。这种一直无法真正的解决真正解决的问题或许才不算是简单且重复性质高。如果是这样,那就太可怕了,只有尖端行业的工作才有价值,大部分维持社会运转的工作都可以交给ai。其实仔细想想看,确实是这样的,ai是一个强烈的生产力工具,可以提升百倍千倍的生产力,这就会出现只需少部分人劳动,多数人躺平的情况发生。小结下,我觉得这种观念的到此为止就不攻自破了。毕竟根本站不住脚,抽象的说,其实和50步笑百步差不多,因为大多数的工作哪怕是有着创造力的工作,只要被量化后,ai都可以很好的处理。二、认为ai很笨,完全不可能替代这里才是最恐怖的,大多数人都没意识到ai的到来或许比前几次工业革命更加爆炸。由于多数人的信息闭塞,用不到人类目前相对顶级的ai,又或者是不屑一顾连用都不用。作为一个AI boy我可以负责任的告诉大家,目前ai的水平在所有的行业中已经是顶级高校博士的水平了,甚至某些层面超过了全部的人类。我觉得首先要正视AI,理性的分析。这类观点常见的论据大概有几种:“它没有意识,所以永远不可能做出真正的创造。”“它只会抄袭和拼接,不会自己思考。”“它现在写的东西一眼就能看出来很假。”这些话听起来都没错,但问题在于:它们讨论的是“终极形态的 AI”,而我们真正要面对的是“工具形态的 AI”。绝大多数岗位被替代,并不需要 AI 具备意识,也不需要它原创出莎士比亚级别的作品,只需要它能够把工作流程拆成若干小步骤,并在其中的大部分步骤上做到:更快、更便宜、更稳定。举个不那么极端、但更贴近现实的例子:一个岗位每天要写 50 封邮件、整理 20 份文档、做 10 次对比、开 5 个会。AI 不需要把“整个岗位”一次性干掉,它只要把邮件写作、文档归纳、信息对齐、会议纪要、简单决策建议这些环节做到 80 分。组织就会发现:原来 10 个人做的事,变成 3 个人加上 AI 就够了。这里面最关键的误区是:大家习惯用“AI 是否完美”去判断“岗位是否安全”。但市场的逻辑从来不是完美主义。对企业来说,替代的阈值往往是“足够好 + 足够便宜”。对个人来说,最危险的不是 AI 比你强,而是 AI 让“你的优势不再稀缺”。所以我并不担心 AI 会不会写出诺贝尔文学奖级别的文章,我更担心的是:那些原本需要你花 5 年才能熟练掌握的技能,可能被一个提示词压缩成 5 分钟。三、真正不会轻易被替代的:热爱驱动的“长期主义”如果前面两种观念都站不住脚,那剩下的问题就变得更尖锐了:在 AI 提升生产力、压缩学习曲线、稀释技能壁垒之后,我们还靠什么区分自己?我越来越觉得答案不在“技能清单”里,而在一个看起来很虚、但极其硬核的东西上:热爱。这里的热爱不是鸡汤式的“做你喜欢的事”,而是指一种能力:你愿意在短期没有回报时继续投入你愿意在枯燥重复时继续打磨你愿意在别人放弃时继续向前当 AI 把“入门”变得廉价,把“标准答案”变得唾手可得时,人和人的差距会更集中地体现在两点:你会不会提出更好的问题。你愿不愿意把一个问题追到足够深。而这两点,往往需要热爱来支撑。因为深入意味着孤独,意味着反复被否定,意味着很长一段时间里你看不到掌声。更现实一点说,未来很多工作的核心竞争力可能会从“会做”变成“持续做”。会做方案的人会越来越多。会写代码的人会越来越多。会做内容的人会越来越多。但能持续三年、五年、十年,在一个领域里迭代自己的认知、审美、判断力的人,依然稀缺。稀缺的东西才有议价权。小结所以我现在更愿意把“不会失业”理解为:不是你永远安全,而是你永远有重新开始的能力。而热爱,是这种能力最稳定的燃料。

ai时代“热爱”尤其珍贵 随着ai时代爆炸的发展,在感叹于ai的能力强大的同时也在后怕,如此的一个强大且不知疲倦的东西是否真的可以替代我们? 现有的工作岗位是否都会被取代? 昨天晚上10点在和朋友交流的过程中,她问我什么岗位以后不会失业呢?确实把我问懵了,随之而来的是无穷的痛苦。结合最近和各种不同层次的人进行讨论的结果,我觉得需要进行总结下,大致分为的以下几种,顺便从一个程序员的角度聊一聊。一、认为容易且缺乏创造性的工作会失业认为低端且重复的工作会被取代,这个概念其实很不严谨。因为每个人对于“低端”、“重复”的定义不同,到底什么是重复性强? 什么是容易?显然我们需要一个清晰的逻辑,才能继续讨论。可能大多数人都认为有一些工作是重复性强的,是容易的。但是要合理的评价事情的容易以及重复性需要建立一个统一的评价指标。毕竟就像是一个简单的mlp(多层感知)的代码实现,对于一个资深的算法工程师来说很简单,但是对于一个大学生来说并不容易。该如何建立这个评价体系是个非常大的问题,如果纯从技术和学术的角度出发,任何已有的知识都是一个简单且容易的事情。例如,修建一条跨海隧道,有很多成功的案例,不困难。真的困难的是人类尚未解决的问题,例如大到,可控核聚变、常温超导体,小到大参数llm模型的幻觉问题。本质是“概率预测”而非“数据库”: LLM 的底层逻辑是下一个词预测 (Next-token prediction)。它们并没有像传统数据库那样存储具体的“事实”,而是通过海量数据学习到了词汇之间的统计和概率关系。当它生成一段看似合理的文本时,它是在进行概率拼接,而不是在“回忆”客观真理。缺乏对真实世界的真正理解: 模型没有常识,也没有物理世界的运行逻辑。只要生成的文本在语法和概率上是顺畅的,模型就会自信地输出,即使内容违背了客观事实。训练数据的局限性: 训练大模型的数据往往包含了互联网上的错误信息、偏见、甚至自相矛盾的内容。模型吸收了这些“有毒”数据,自然也会在输出中反映出来。这种一直无法真正的解决真正解决的问题或许才不算是简单且重复性质高。如果是这样,那就太可怕了,只有尖端行业的工作才有价值,大部分维持社会运转的工作都可以交给ai。其实仔细想想看,确实是这样的,ai是一个强烈的生产力工具,可以提升百倍千倍的生产力,这就会出现只需少部分人劳动,多数人躺平的情况发生。小结下,我觉得这种观念的到此为止就不攻自破了。毕竟根本站不住脚,抽象的说,其实和50步笑百步差不多,因为大多数的工作哪怕是有着创造力的工作,只要被量化后,ai都可以很好的处理。二、认为ai很笨,完全不可能替代这里才是最恐怖的,大多数人都没意识到ai的到来或许比前几次工业革命更加爆炸。由于多数人的信息闭塞,用不到人类目前相对顶级的ai,又或者是不屑一顾连用都不用。作为一个AI boy我可以负责任的告诉大家,目前ai的水平在所有的行业中已经是顶级高校博士的水平了,甚至某些层面超过了全部的人类。我觉得首先要正视AI,理性的分析。这类观点常见的论据大概有几种:“它没有意识,所以永远不可能做出真正的创造。”“它只会抄袭和拼接,不会自己思考。”“它现在写的东西一眼就能看出来很假。”这些话听起来都没错,但问题在于:它们讨论的是“终极形态的 AI”,而我们真正要面对的是“工具形态的 AI”。绝大多数岗位被替代,并不需要 AI 具备意识,也不需要它原创出莎士比亚级别的作品,只需要它能够把工作流程拆成若干小步骤,并在其中的大部分步骤上做到:更快、更便宜、更稳定。举个不那么极端、但更贴近现实的例子:一个岗位每天要写 50 封邮件、整理 20 份文档、做 10 次对比、开 5 个会。AI 不需要把“整个岗位”一次性干掉,它只要把邮件写作、文档归纳、信息对齐、会议纪要、简单决策建议这些环节做到 80 分。组织就会发现:原来 10 个人做的事,变成 3 个人加上 AI 就够了。这里面最关键的误区是:大家习惯用“AI 是否完美”去判断“岗位是否安全”。但市场的逻辑从来不是完美主义。对企业来说,替代的阈值往往是“足够好 + 足够便宜”。对个人来说,最危险的不是 AI 比你强,而是 AI 让“你的优势不再稀缺”。所以我并不担心 AI 会不会写出诺贝尔文学奖级别的文章,我更担心的是:那些原本需要你花 5 年才能熟练掌握的技能,可能被一个提示词压缩成 5 分钟。三、真正不会轻易被替代的:热爱驱动的“长期主义”如果前面两种观念都站不住脚,那剩下的问题就变得更尖锐了:在 AI 提升生产力、压缩学习曲线、稀释技能壁垒之后,我们还靠什么区分自己?我越来越觉得答案不在“技能清单”里,而在一个看起来很虚、但极其硬核的东西上:热爱。这里的热爱不是鸡汤式的“做你喜欢的事”,而是指一种能力:你愿意在短期没有回报时继续投入你愿意在枯燥重复时继续打磨你愿意在别人放弃时继续向前当 AI 把“入门”变得廉价,把“标准答案”变得唾手可得时,人和人的差距会更集中地体现在两点:你会不会提出更好的问题。你愿不愿意把一个问题追到足够深。而这两点,往往需要热爱来支撑。因为深入意味着孤独,意味着反复被否定,意味着很长一段时间里你看不到掌声。更现实一点说,未来很多工作的核心竞争力可能会从“会做”变成“持续做”。会做方案的人会越来越多。会写代码的人会越来越多。会做内容的人会越来越多。但能持续三年、五年、十年,在一个领域里迭代自己的认知、审美、判断力的人,依然稀缺。稀缺的东西才有议价权。小结所以我现在更愿意把“不会失业”理解为:不是你永远安全,而是你永远有重新开始的能力。而热爱,是这种能力最稳定的燃料。